Canary Deployment: Rollout Sicuri per Sistemi ad Alto Traffico

Come funziona il canary deployment, come configurare le percentuali di traffico, cosa monitorare e quando usare canary vs. blue-green deployment.

In questo articolo:

- Cos’è il canary deployment e perché funziona

- Configurare le percentuali di traffico e la progressione

- Cosa monitorare durante un rollout canary

- Canary deployment e feature flag

- Conclusione

Il canary deployment è una strategia di rilascio che instrada una piccola percentuale di traffico di produzione verso una nuova versione prima di distribuirla a tutti gli utenti. Il nome viene dalla pratica di portare uccelli canari nelle miniere di carbone: se il canarino moriva, i minatori sapevano che l’aria non era sicura. In termini software, se il canary deployment fallisce, il team lo sa prima che il fallimento riguardi la maggior parte degli utenti.

Per i sistemi ad alto traffico, il canary deployment è l’approccio standard per rilasciare cambiamenti che comportano un rischio significativo. Un bug che riguarda il 5% degli utenti su un canary è recuperabile. Lo stesso bug distribuito al 100% in una volta è un incidente P1.

Cos’è il canary deployment e perché funziona

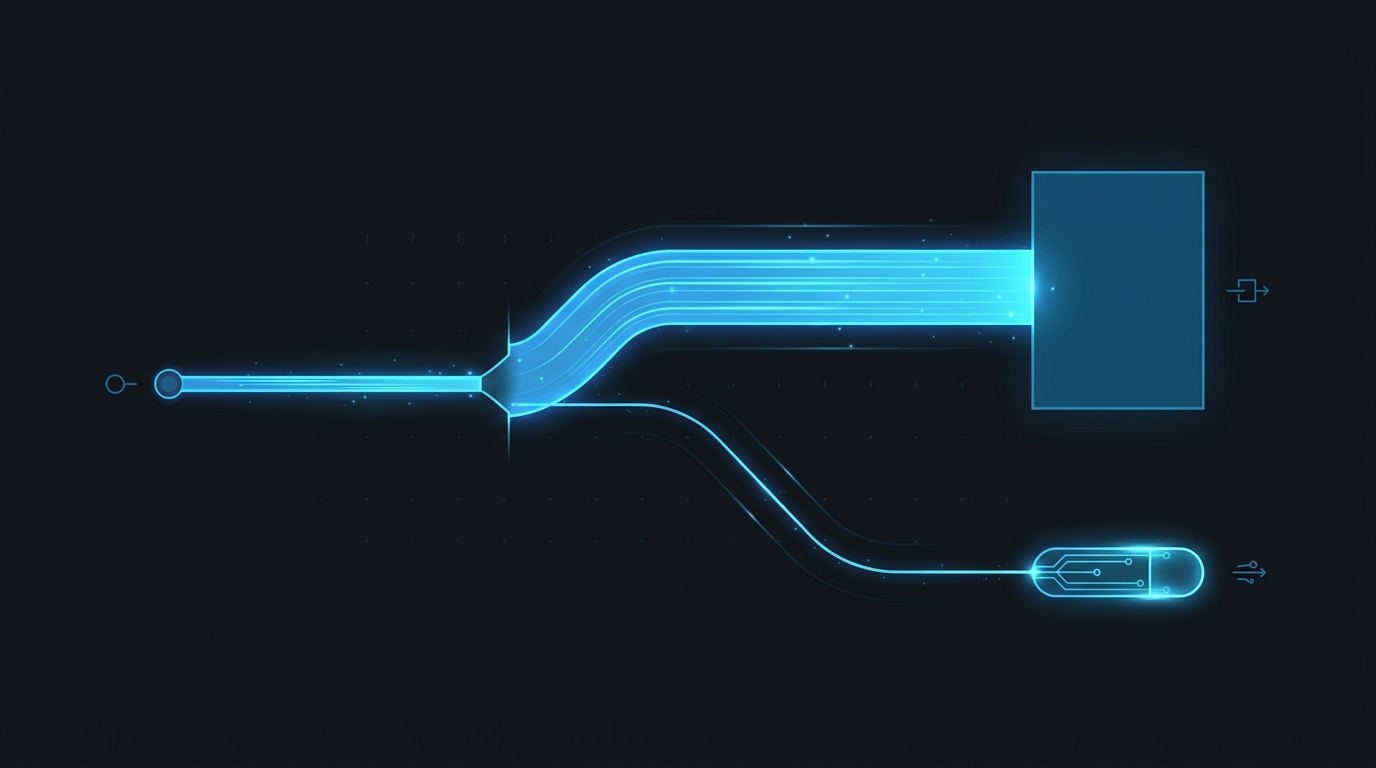

In un canary deployment, il traffico è diviso tra la versione di produzione corrente e la nuova versione usando routing pesato a livello di load balancer o service mesh. Una progressione tipica: 5% al canary per 30 minuti, poi 25%, poi 50%, poi 100% (rollout completo). Se qualsiasi passo mostra degradazione nelle metriche, il traffico torna allo 0% sul canary e il team investiga.

Il meccanismo funziona perché i bug di produzione hanno spesso un impatto non uniforme sulla popolazione degli utenti. Una regressione che si attiva solo su versioni specifiche del browser, tipi di account o pattern di dati si manifesterà nel traffico canary al suo tasso effettivo di occorrenza, piuttosto che apparire improvvisamente su tutti gli utenti quando il rollout completo si conclude.

Questo è il vantaggio chiave rispetto al blue-green deployment per i cambiamenti con comportamento incerto: il blue-green è atomico, il canary è graduale. Il team può osservare il comportamento reale di produzione su scala limitata prima di impegnarsi nel rollout completo.

La metrica del change failure rate nei framework DORA è direttamente influenzata dalle pratiche di canary deployment. I team con pipeline canary automatizzate vedono tipicamente tassi di fallimento dei cambiamenti inferiori al 5%. I team che distribuiscono direttamente al 100% della produzione senza test canary vedono tipicamente tassi superiori al 15%.

Configurare le percentuali di traffico e la progressione

La progressione del traffico dovrebbe essere calibrata al livello di rischio del cambiamento e al volume di traffico che il sistema gestisce.

Per sistemi ad alto traffico (milioni di richieste/giorno): Anche l’1% del traffico fornisce segnali statisticamente significativi in pochi minuti. Una progressione tipica per un cambiamento ad alto rischio: 1% per 15 minuti, 5% per 30 minuti, 25% per 30 minuti, 100%. Questa progressione completa richiede circa 90 minuti e fornisce solida fiducia ad ogni passo.

Per sistemi a traffico moderato: Inizia al 5-10% e osserva per periodi più lunghi prima di avanzare. Con volumi di traffico inferiori, hai bisogno di più tempo ad ogni percentuale per accumulare abbastanza richieste da distinguere il segnale dal rumore.

Per sistemi a basso traffico (meno di 100 richieste/giorno): Il canary deployment fornisce valore statistico limitato a bassi volumi di traffico. Considera invece il blue-green deployment con smoke test completi.

Progressione automatizzata vs. manuale. Le pipeline canary automatizzate avanzano la percentuale automaticamente se le metriche rimangono entro le soglie, e si fermano se le metriche superano le soglie. Questo richiede di definire intervalli accettabili per tasso di errore, latenza e qualsiasi metrica di business prima che il deployment inizi.

Infrastruttura: AWS CodeDeploy, Argo Rollouts, Spinnaker e Flagger supportano tutti le progressioni canary automatizzate con integrazione di metriche configurabile.

Cosa monitorare durante un rollout canary

Il monitoraggio è il nucleo operativo del canary deployment. Le metriche che monitori determinano se catturi i problemi presto o li perdi fino al rollout completo.

Tasso di errore. Confronta il tasso di errore delle istanze canary con il tasso di errore delle istanze stabili nello stesso periodo. Un tasso di errore canary 2 volte o più superiore alla baseline è un segnale forte per fermarsi.

Latenza. Confronta la latenza p50, p95 e p99 per le istanze canary e stabili. Una regressione che aggiunge 200ms al tempo di risposta mediano sarà tipicamente visibile al 5% del traffico entro 15-30 minuti su un sistema ad alto traffico.

Metriche di business. Per i servizi rivolti agli utenti, monitora il tasso di conversione, il tasso di successo delle transazioni e la durata della sessione per gli utenti che colpiscono il canary vs. la versione stabile. Una nuova pagina di checkout che sembra tecnicamente corretta ma riduce la conversione del 3% è una regressione che le metriche di tasso di errore e latenza non cattureranno.

Utilizzo delle risorse. CPU, memoria e utilizzo del pool di connessioni sulle istanze canary. Una nuova versione con un memory leak mostrerà un utilizzo crescente della memoria nel canary prima che causi un OOM nel rollout completo.

Configura dashboard che mostrano queste metriche divise per versione di deployment (canary vs. stabile) prima di iniziare il rollout.

Canary deployment e feature flag

Il canary deployment e i feature flag sono tecniche complementari che operano a livelli diversi.

Il canary deployment instrada una percentuale di richieste a una versione diversa dell’applicazione a livello infrastrutturale. Tutti gli utenti che colpiscono le istanze canary vedono il nuovo comportamento. Il routing è per richiesta, non per identità utente.

I feature flag controllano il comportamento all’interno di una singola versione dell’applicazione a livello di codice. Un feature flag può essere abilitato per un utente specifico, un account specifico, una percentuale di utenti o una regione geografica specifica.

Combinati: distribuisci la nuova versione come canary (5% del traffico), e all’interno di quel canary, abilita la nuova funzionalità per il 50% degli utenti tramite un feature flag. Questo dà un tasso di esposizione del 2,5% mantenendo la coerenza a livello utente (un utente specifico vede sempre il vecchio comportamento o sempre il nuovo comportamento, piuttosto che cambiare casualmente ad ogni richiesta).

Questa combinazione è l’approccio standard per testare in produzione cambiamenti ad alto rischio rivolti agli utenti. Riduce il raggio d’azione al 2-5% degli utenti, mantiene la coerenza comportamentale all’interno delle sessioni e fornisce dati A/B puliti per valutare l’impatto del cambiamento.

I feature flag abilitano anche la disabilitazione istantanea senza rollback. Se viene rilevato un problema con una funzionalità specifica, il flag può essere spento in meno di 60 secondi senza ridistribuire o cambiare il routing del traffico.

Conclusione

Il canary deployment riduce il change failure rate esponendo il nuovo codice al traffico di produzione in modo incrementale, con condizioni di arresto automatico e rollback rapido. Per i sistemi ad alto traffico, è l’approccio standard per rilasciare cambiamenti che comportano un rischio significativo.

L’investimento richiesto: routing pesato a livello di load balancer o service mesh, dashboard di monitoraggio divise per versione di deployment e soglie definite per le condizioni di arresto automatico. I team che hanno questa infrastruttura distribuiscono cambiamenti che in precedenza richiedevano cicli di rilascio di due settimane in rollout canary giornalieri, con tassi di fallimento dei cambiamenti inferiori al 5% e mean time to recovery inferiore a 10 minuti.

Hai un codebase con questi problemi? Parliamo del tuo sistema